CalypsoAI’s numbers, he said, “show how strong that pull is. Their data shows that more than half of workers say they would use AI even if their organization’s policy says no, a third have already used it on sensitive documents, and almost half of surveyed security teams admitted to having pasted proprietary material into public tools. I’m not sure it’s as much about disloyalty as it is about how governance and enablement lag behind how people work today.”

O risco aqui é claro, acrescentou St-Maurice, porque todo prompt não monitorado pode levar a propriedade intelectual, estratégias corporativas, contratos sensíveis ou dados de clientes que vazam ao público. “E naturalmente”, observou ele, “se ele bloquear esses serviços de IA, ele levará os usuários mais subterrâneos a procurar novas maneiras de acessá -los. A correção prática é através da capacitação estruturada”.

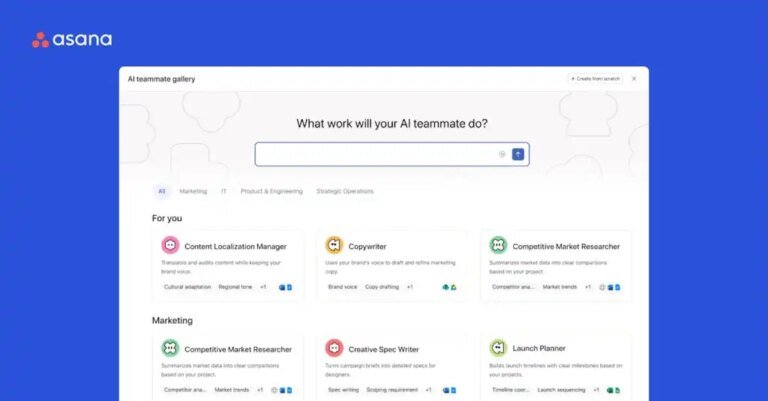

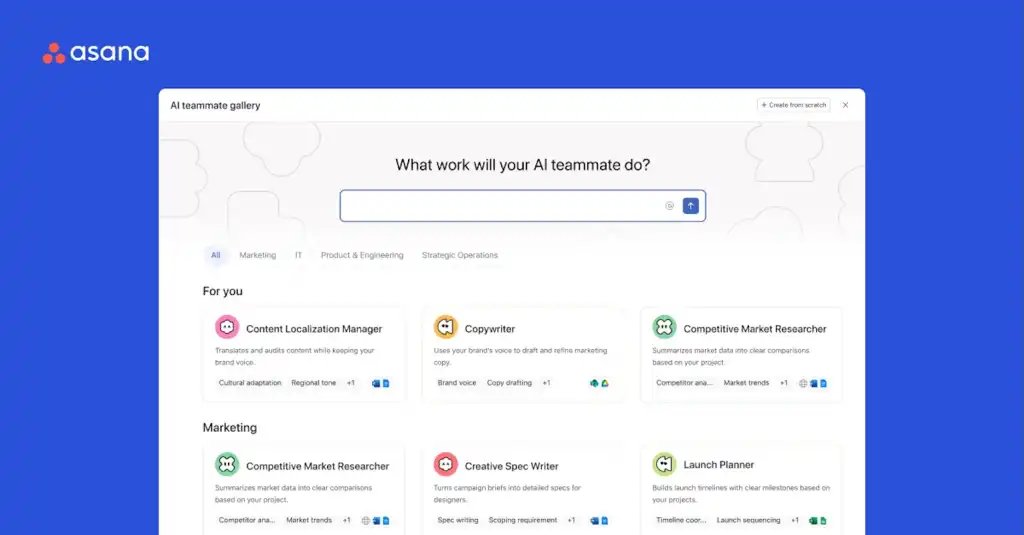

Uma estratégia adequada, disse ele, é fornecer um gateway de IA sancionado, conectá -lo à identidade, avisos e saídas de log, aplicar redação para campos sensíveis e publicar algumas regras claras e claras que as pessoas conseguem se lembrar. Isso deve ser combinado com treinamento curto e baseado em funções e um catálogo de modelos e casos de uso aprovados. Isso dá aos funcionários um caminho seguro para os mesmos ganhos.

Fonte: Computer World